Iedereen gebruikt AI tegenwoordig. Voor mailtjes, offertes, social posts, en steeds vaker ook voor blogs en websiteteksten. Begrijpelijk. Het is snel, het is makkelijk, en het ziet er op het eerste gezicht prima uit. Maar er is een risico dat de meeste mensen niet zien aankomen. En dat risico is waarschijnlijk een stuk groter dan je denkt.

Wat er mis kan gaan

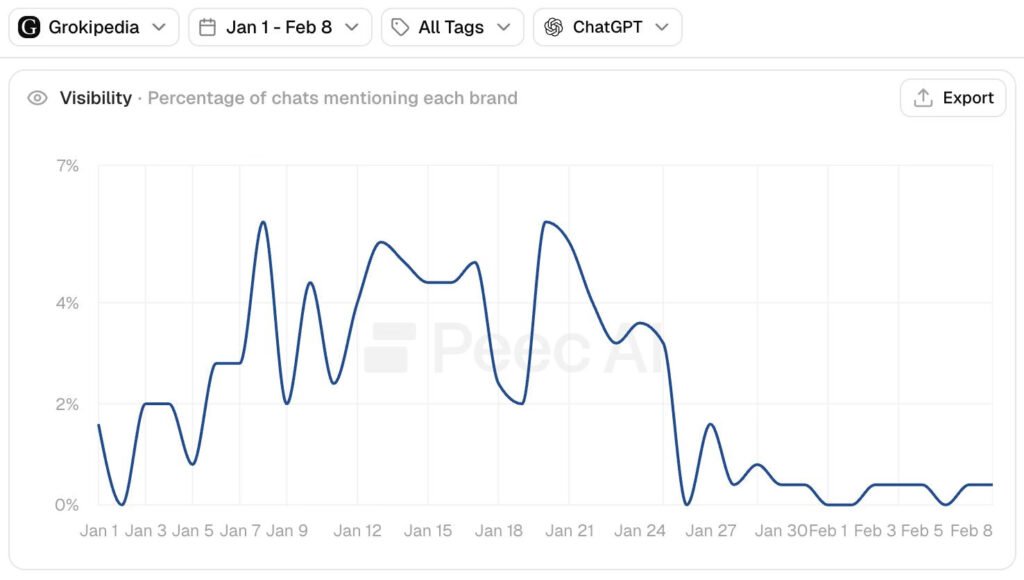

Laten we beginnen met een concreet voorbeeld. Grokipedia (een AI-gegenereerde variant van Wikipedia, aangedreven door Grok) groeide snel in zoekresultaten. En zakte daarna even snel weer weg. Eind januari, begin februari 2025 verloor het platform flink terrein in Google.

Wat opvallend was: op exact hetzelfde moment begonnen AI-tools zoals ChatGPT, Google AI Mode en AI Overviews het minder te citeren. Niet na verloop van tijd. Niet geleidelijk, maar gelijktijdig.

Bron: Peec AI analyseerde deze trend en publiceerde de bevindingen inclusief onderstaande grafiek. Lees het volledige artikel hier.

Afbeelding: zichtbaarheid van Grokipedia in AI-antwoorden – bron: Peec AI

Dit is geen toeval, want Google en AI-tools zijn met elkaar verweven. Veel AI-zoekmachines zoals ChatGPT en Grok gebruiken Google actief als databron. Een penalty in Google heeft dus direct gevolgen voor je zichtbaarheid in AI. Eén klap, overal onzichtbaar.

Kan Google AI-content herkennen?

Veel mensen denken van niet. “AI schrijft tegenwoordig zo goed, dat Google het toch niet meer ziet?” Dat is een misvatting.

Google werkt al jaren aan het herkennen van automatisch gegenereerde content. Ze hebben 16.000 menselijke reviewers die content beoordelen, en die beoordelingen worden gebruikt als trainingsdata voor hun algoritmes. In 2025 zijn de Quality Rater Guidelines specifiek aangescherpt om “low-effort” AI-content te targeten. Pagina’s zonder originele inhoud worden nu als laagste kwaliteit beoordeeld, ongeacht hoe ze zijn gemaakt.

Er zijn aanwijzingen dat AI-bedrijven zoals Google en OpenAI hun eigen modellen beter kunnen detecteren dan externe tools, omdat ze direct toegang hebben tot de kansverdelingen van hun modellen. Ze weten dus eerder dan jij of een tekst door hun eigen model is gegenereerd.

En dan zijn er nog de gebruikerssignalen. Klikt iemand door naar jouw pagina, ziet dat het generieke AI-tekst is, en gaat meteen terug naar Google? Dat registreert Google. Elke keer. Google ontkende dit jarenlang, maar de eigen patenten én de antitrustzaken hebben inmiddels bevestigd dat gebruiksgedrag wél meespeelt in rankings.

Wat zegt EEAT hierover?

EEAT staat voor Experience, Expertise, Authoritativeness en Trustworthiness, het kader dat Google gebruikt om te beoordelen of content de moeite waard is. En dit is precies waar AI-content structureel tekortschiet.

Experience gaat over echte, persoonlijke ervaring met een onderwerp. AI heeft geen ervaring. Het heeft patronen geleerd uit bestaande teksten. Dat is niet hetzelfde als iemand die al tien jaar in een vakgebied werkt en schrijft vanuit eigen praktijk.

Expertise betekent dat je ergens echt verstand van hebt, en dat dat ook zichtbaar is in hoe je schrijft. AI produceert plausibele tekst, maar geen diepgaande inzichten.

Authoritativeness bouw je op door consequent waardevolle content te publiceren en erkend te worden als bron door anderen. Generieke AI-teksten die op elke site hetzelfde klinken, dragen daar niet aan bij.

Trustworthiness ten slotte is het meest kwetsbare punt. Zodra een lezer (of Google) merkt dat je content simpelweg uit een AI is gekopieerd zonder eigen perspectief, daalt het vertrouwen. En vertrouwen is heel moeilijk terug te winnen.

Mijn eigen mening: EEAT is niet alleen een Google-dingetje. Het is ook wat goede content onderscheidt van slechte content. En AI kan dat (nog) niet overnemen.

Maar AI is toch juist handig?

Ja. Absoluut. Ik gebruik AI ook. Maar er is een groot verschil tussen AI als hulpmiddel en AI als vervanger.

AI gebruiken om je structuur te checken, een eerste opzet te maken of een tekst strakker te formuleren? Prima. Maar een tekst klakkeloos publiceren die je rechtstreeks uit ChatGPT hebt gekopieerd, zonder er eigen kennis, ervaring of perspectief aan toe te voegen? Dat is waar het misgaat.

De SEO-expert Lily Ray verwoordt het goed: AI kan enorm helpen bij het sneller (en efficiënter) maken van het schrijfproces, maar overmatig vertrouwen op puur AI-gegenereerde content, zeker als dat snel en op grote schaal wordt gepubliceerd, kan je SEO-prestaties serieus beschadigen. Het is en blijft belangrijk dat je content unieke inzichten, eigen expertise en een perspectief bevat dat concurrenten niet zomaar kunnen kopiëren.

Twee vragen die ik mezelf stel

Voordat ik iets publiceer (of ik het nu zelf heb geschreven of met hulp van AI) stel ik mezelf twee vragen:

- Zou ik dit artikel zelf willen lezen?

- Voegt dit iets toe wat er nog niet is?

Als het antwoord op één van die vragen nee is, gaat de tekst terug naar de tekentafel. Want content die niemand bijzonders vindt, wordt ook door Google en AI niet bijzonder gevonden.

Wat betekent dit voor jouw website?

Als jij als ondernemer of tekstschrijver AI gebruikt voor je website, hoef je daar niet mee te stoppen. Maar wees je bewust van de risico’s van content die geen eigen waarde toevoegt. Bouw aan je EEAT. Schrijf vanuit je eigen ervaring. Voeg iets toe wat niet al op honderd andere websites staat. En gebruik AI als assistentm niet als auteur.

Over de auteur: Rosanne Keller is SEO-specialist en eigenaar bij Keller SEO en helpt ondernemers zichtbaar te worden in zowel Google als AI-zoekmachines. Ze biedt onder andere SEO voor AI aan als dienst.